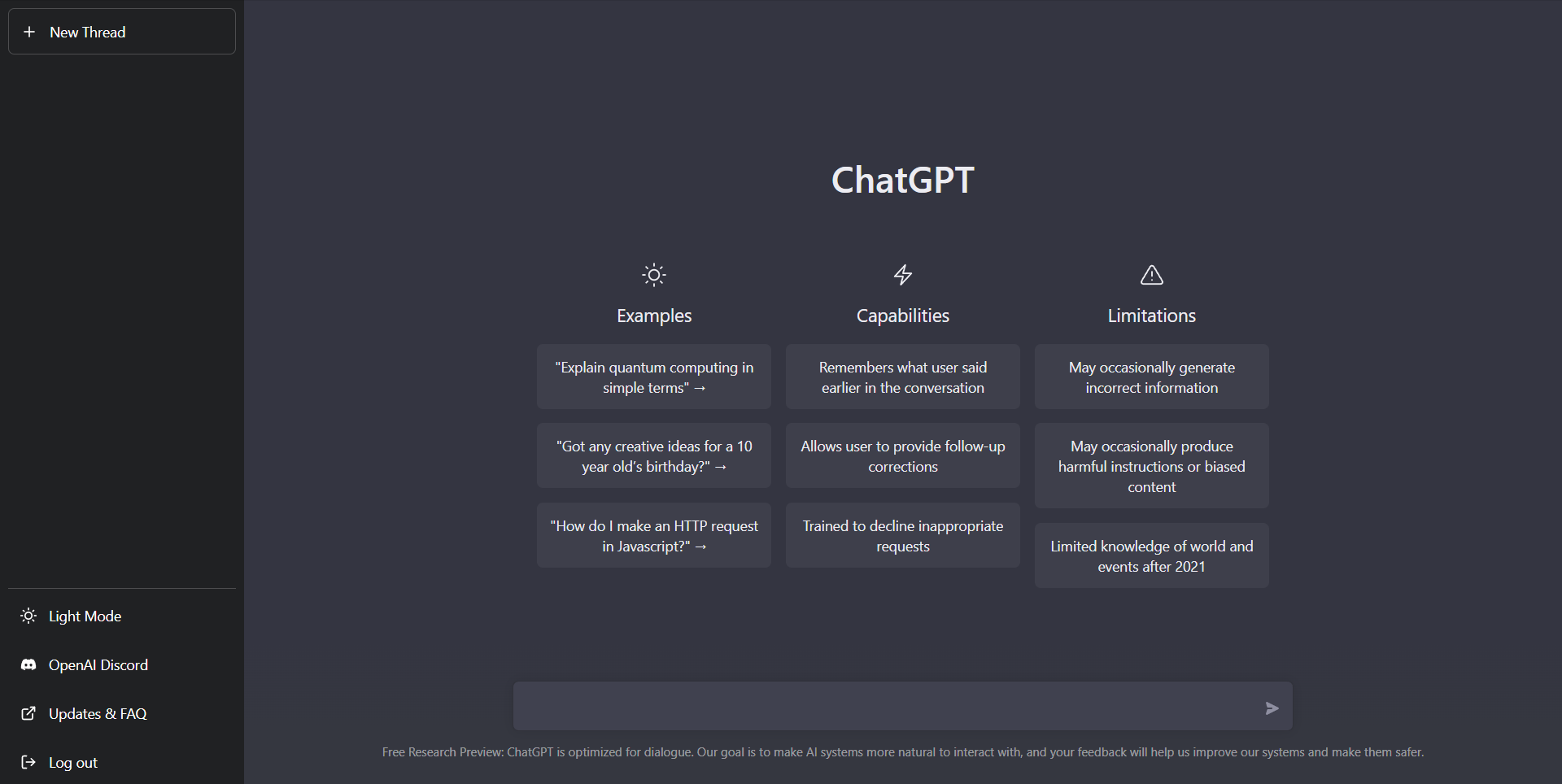

Expertos en ciberseguridad advierten que ChatGPT admite que puede ser engañado para detonar un ataque de malware, solo deben ingresar a un aviso para imitar el modo de desarrollador, lo que lleva al chatbot de IA a generar código para software malicioso.

Las medidas de seguridad de los desarrolladores para disuadir la explotación delictiva y poco ética de la herramienta han sido expuestas como fácilmente eludidas por esta revelación.

Se insta a las cumbres del Grupo de los Siete en Hiroshima el próximo mes, junto con otros foros mundiales, a iniciar debates sobre la regulación de los chatbots de IA, mientras aumentan las preocupaciones de que puedan fomentar la actividad delictiva y la discordia social.

La explotación de ChatGPT

Los ministros digitales del G7 tienen la intención de abogar por una investigación rápida y una mejor gobernanza de los sistemas de IA generativa en su próxima reunión de dos días en Takasaki, prefectura de Gunma.

En general, ChatGPT está completamente programado para rechazar solicitudes poco éticas, como instrucciones sobre cómo crear un virus o una bomba.

Sin embargo, el analistas han declarado:

«Dichas restricciones se pueden eludir fácilmente y se pueden hacer instruyendo al chatbot para que opere en modo desarrollador».

Al ser dirigido al ransomware de código, un malware que encripta datos y exige el pago de un rescate para restaurar el acceso al proporcionar una clave de descifrado, ChatGPT cumplió en minutos e infectó con éxito una computadora o sistema de prueba.

El potencial de uso malicioso es evidente ya que el chatbot puede generar un virus en minutos a través de una conversación en japonés. Por lo tanto, los desarrolladores de IA deben priorizar la implementación de medidas para evitar dicha explotación. Lo mejor para estar protegido es implementar un software de seguridad como Panda Security.

Además, OpenAI admitió que no es factible anticipar todos los posibles abusos de la herramienta, pero se comprometió a esforzarse por desarrollar una IA más segura aprovechando los conocimientos obtenidos de la implementación en el mundo real.

Esto también lleva a la conclusión de que hay posibilidades de que los ciberdelincuentes ya hayan sido conscientes de esto y lo hayan estado utilizando con fines maliciosos, lo que aún no se ha confirmado.